ITCOW牛新网 12月17日消息,腾讯今日发布混元世界模型1.5(Tencent HY WorldPlay),并首次开源业界最系统、最全面的实时世界模型框架。该版本突破性地实现了24帧/秒的实时交互生成能力,支持用户在高清生成的世界中自由探索并保持场景一致性。

据ITCOW牛新网了解,该模型具备三大核心突破:通过原创Context Forcing蒸馏方案实现720P高清视频的实时生成;采用重构记忆机制确保长时间3D场景的几何一致性;支持多视角切换与实时交互,可适配游戏开发、影视制作等多样化场景。特别值得注意的是,模型能够”记忆”用户探索过的区域,当再次返回时保持场景结构一致,这一能力为构建可持续探索的虚拟世界奠定基础。

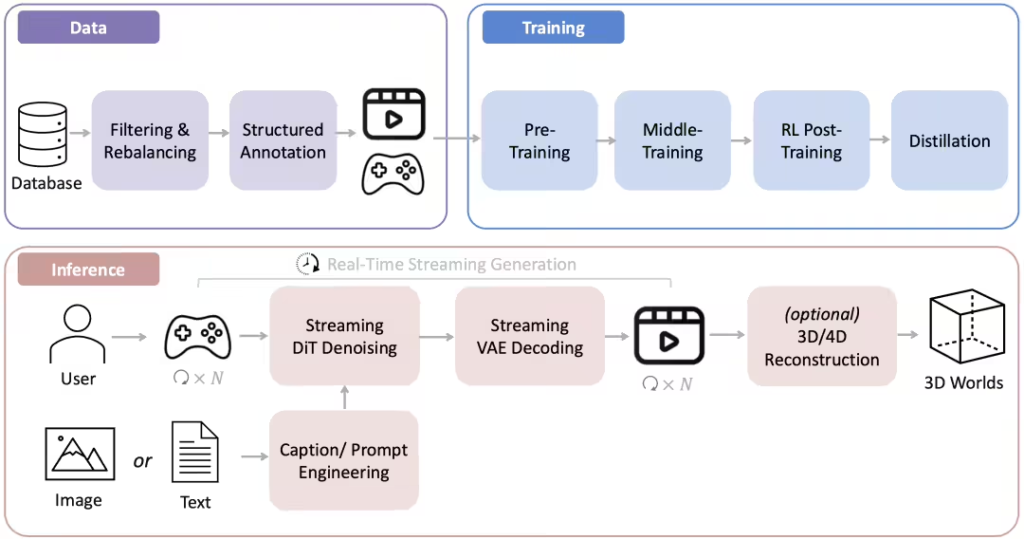

本次开源的框架涵盖数据构建、优化到流式推理的全链路技术体系。技术核心采用名为WorldPlay的自回归扩散模型,通过Next-Frames-Prediction训练任务,结合双分支动作表征、记忆重构等创新模块,有效解决了实时性与一致性难以兼顾的行业难题。团队还构建了基于3D奖励的强化学习框架,并利用自动化渲染流程生成高质量训练数据。

该技术已展现出广泛的应用潜力:在游戏开发领域可作为智能关卡生成器,根据文本描述实时创建可探索世界;在影视制作中能预览场景设计;在具身智能研究方面则为感知决策提供高效训练平台。模型支持第一/第三人称视角切换,并具备视频续写、事件触发等交互功能。

腾讯混元团队自今年7月发布1.0版本以来持续迭代,此次升级标志着世界模型技术从概念验证走向实用化阶段。目前模型已开通在线体验通道,并同步在GitHub、Hugging Face等平台开放完整技术资料,为行业开发者提供完整的工具链支持。