ITCOW牛新网 1月28日消息,谷歌DeepMind团队昨日发布Gemini 3 Flash模型的“智能体视觉”功能,该技术突破传统AI图像处理的静态扫描模式,将视觉理解转变为主动调查过程。通过结合视觉推理与代码执行能力,模型可模仿人类“思考-行动-观察”的认知循环,实现对图像内容的深度解析。

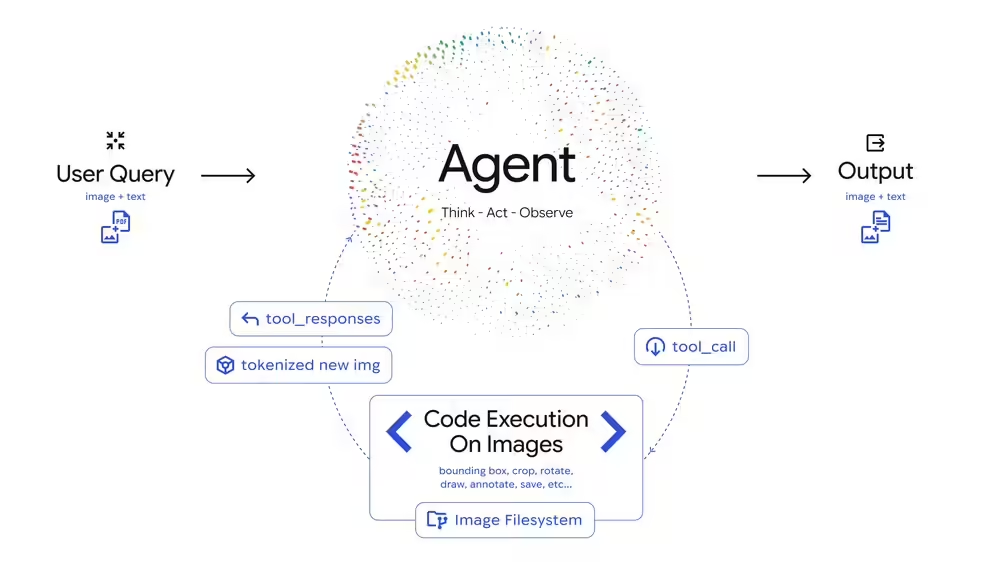

传统AI模型在处理图像时通常仅进行单次静态扫描,若遗漏芯片序列号或远处路牌等细微细节,便只能依靠猜测生成答案。而Gemini 3 Flash的智能体视觉功能形成了完整的“思考-行动-观察”闭环:在思考阶段,模型分析用户查询和初始图像,制定多步计划;行动阶段生成并执行Python代码来操作图像(如裁剪、旋转、标注)或进行分析计算;观察阶段则将变换后的图像追加到上下文窗口中进行二次验证。这一机制使模型能够基于视觉证据生成准确答案,而非依赖概率猜测。

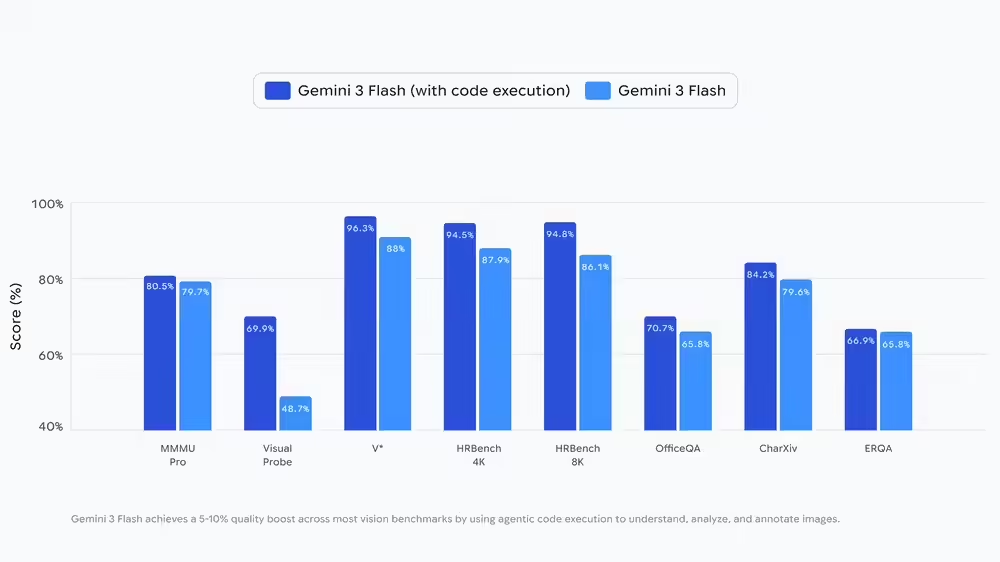

据ITCOW牛新网了解,该技术在多个应用场景展现显著优势。在建筑图纸验证平台PlanCheckSolver.com的实际测试中,模型通过代码裁剪并分析屋顶边缘等高分辨率细节,使准确率提升5%。处理视觉数学问题时,模型可编写代码识别原始数据并调用Matplotlib库绘制精确图表,有效解决了大型语言模型在多步视觉算术中的“幻觉”问题。测试数据显示,引入代码执行能力后,Gemini 3 Flash在多数视觉基准测试中的质量提升达5-10%。

谷歌DeepMind表示,当前版本已能智能判断何时需要放大细节进行深入分析,未来迭代将实现更高级的自动化处理能力,无需用户显式提示即可自动执行图像旋转或视觉运算等操作。