ITCOW牛新网 1月28日消息,蚂蚁集团旗下具身智能公司蚂蚁灵波科技今日宣布,正式开源其LingBot-VLA具身大模型及后训练代码。该模型已与星海图、松灵、乐聚等机器人厂商完成适配验证,在跨本体迁移能力方面表现突出。其配套训练工具链在8卡GPU配置下实现单卡每秒261样本的吞吐量,效率达主流框架1.5至2.8倍。

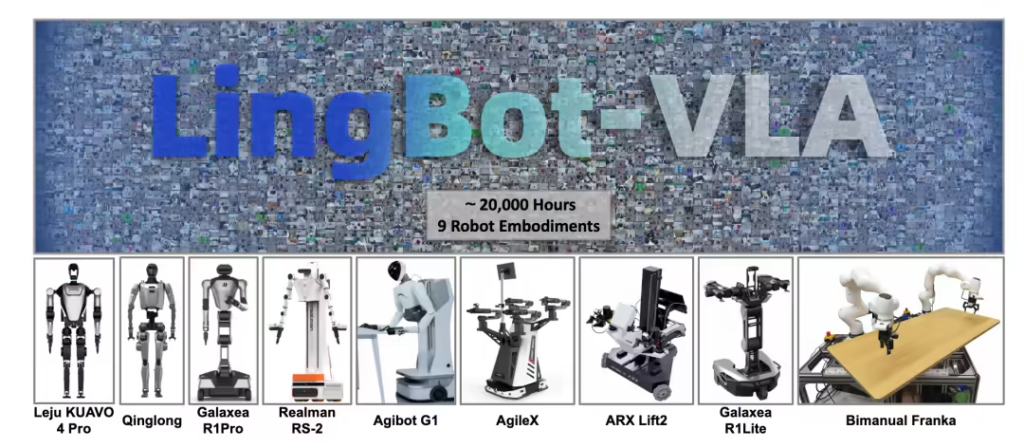

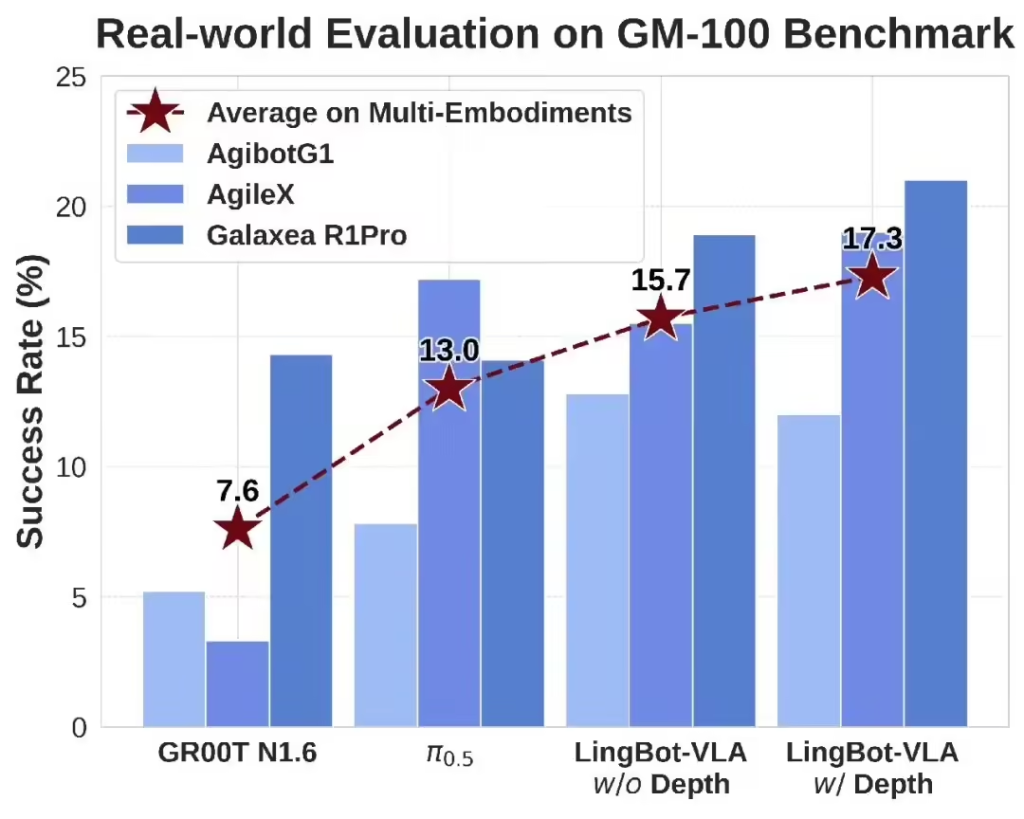

通过系统研究VLA模型性能随数据规模增长的规律,项目发现预训练数据量从3000小时逐步提升至20000小时过程中,下游任务成功率持续显著提升。基于此,蚂蚁灵波构建了覆盖9种主流双臂机器人构型的20000小时真实训练数据集。在上海交通大学GM-100基准测试中,LingBot-VLA在三个不同机器人平台上的跨本体泛化平均成功率从基线13.0%提升至15.7%,引入深度感知后进一步优化至17.3%。

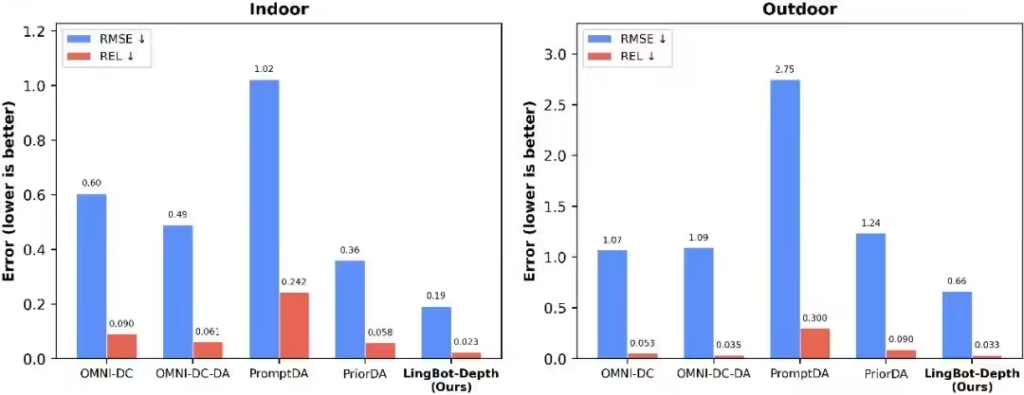

据ITCOW牛新网了解,蚂蚁灵波科技还于1月27日开源了LingBot-Depth空间感知模型。该模型依托奥比中光Gemini 330系列双目3D相机进行RGB-Depth数据采集与优化,能将不完整的深度传感器数据转化为高质量三维测量结果。实验表明,其在NYUv2、ETH3D等基准测试的深度补全、单目深度估计及双目匹配任务中均达到当前最优水平,且无需显式时序建模即可保持视频级时间一致性。