ITCOW牛新网 2月10日消息,腾讯混元今日发布专为消费级硬件优化的超小型语言模型HY-1.8B-2Bit。该模型采用2比特量化技术,等效参数量压缩至0.3B,内存占用仅600MB,体积小于多数手机应用,可在移动设备、物联网终端等边缘场景实现高效部署。

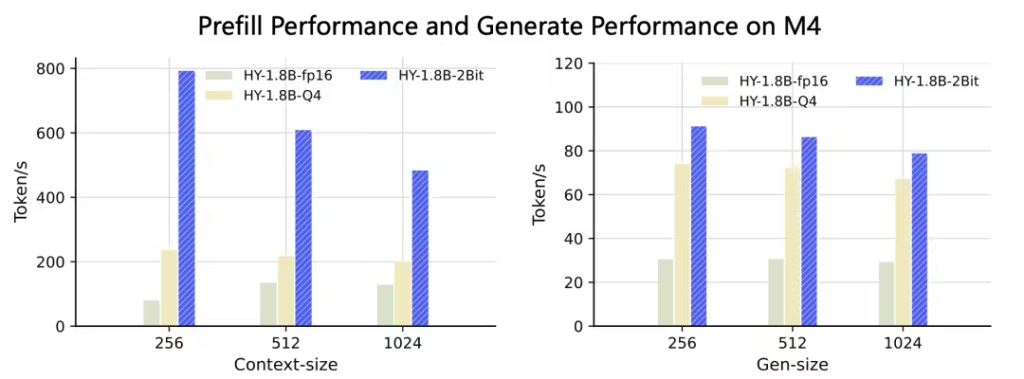

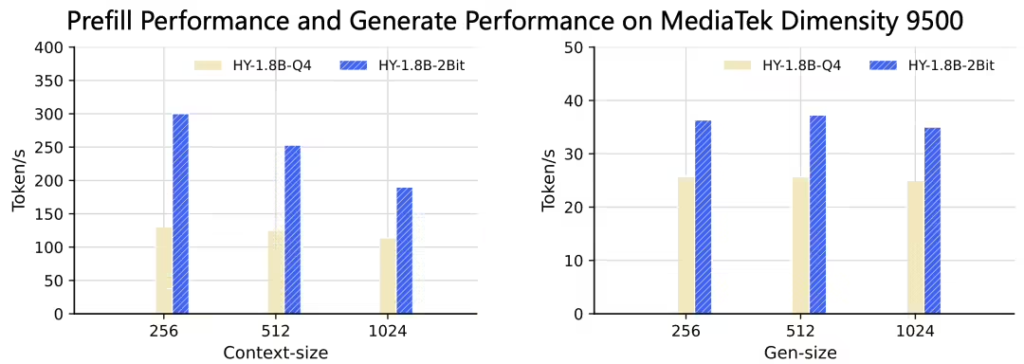

HY-1.8B-2Bit基于产业级2Bit端侧量化方案开发,通过量化感知训练对原有模型进行深度优化。实测数据显示,其在端侧设备上的文本生成速度较原始精度模型提升2-3倍,同时完整保留了思维链能力,支持用户根据任务复杂度自由切换简洁或详细输出模式。

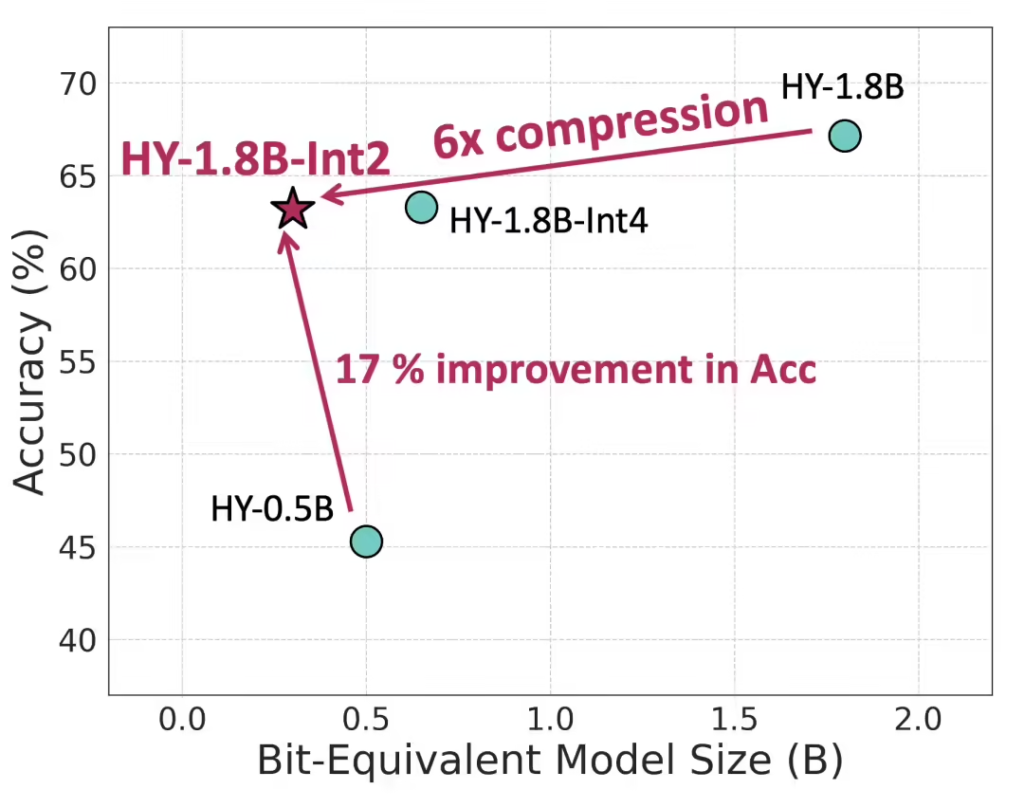

据ITCOW牛新网了解,该模型创新性解决了低比特量化的精度损失难题。其2比特表示虽仅支持4种状态,但通过弹性拉伸与训练策略优化,在数学、代码等核心指标上已接近4比特PTQ模型水平。模型提供gguf-int2格式权重,文件大小仅300MB,并已完成对Arm SME2架构移动设备的适配。

部署测试显示,在MacBook M4芯片平台上,模型首字响应速度提升3-8倍,文本生成效率实现2倍以上增长;天玑9500平台同样取得1.5-2倍性能提升。研发团队表示,未来将重点探索强化学习与模型蒸馏技术,进一步缩小低比特与全精度模型的性能差距,为边缘AI应用提供更强大支持。