ITCOW牛新网 3月12日消息,英伟达公司于昨日(3月11日)正式发布其新一代开源大模型 Nemotron 3 Super。该模型拥有高达 1200亿参数,采用创新的混合专家(MoE)架构,旨在解决当前AI智能体(Agent)系统面临的“上下文爆炸”与“推理税”两大核心瓶颈,为构建复杂多智能体应用提供强大的底层支持。

据ITCOW牛新网了解,Nemotron 3 Super 是英伟达迄今为止最强大的开源权重(Open-weight)AI模型。与完全闭源的模型不同,开源权重模型允许开发者下载模型参数,在本地设备上自由运行、微调甚至修改,这为企业级私有化部署和数据安全提供了极大的灵活性。

随着企业应用从简单的聊天机器人转向复杂的多智能体系统,传统的模型架构往往难以应对海量交互数据带来的挑战。Nemotron 3 Super 针对性地引入了多项突破性技术:

- 100万Token超长上下文:模型配备了高达100万Token的上下文窗口,能够一次性加载完整的代码库或数千页财务报告,让智能体将完整的工作流状态保留在内存中,有效防止目标偏移,并大幅降低多步推理的成本。

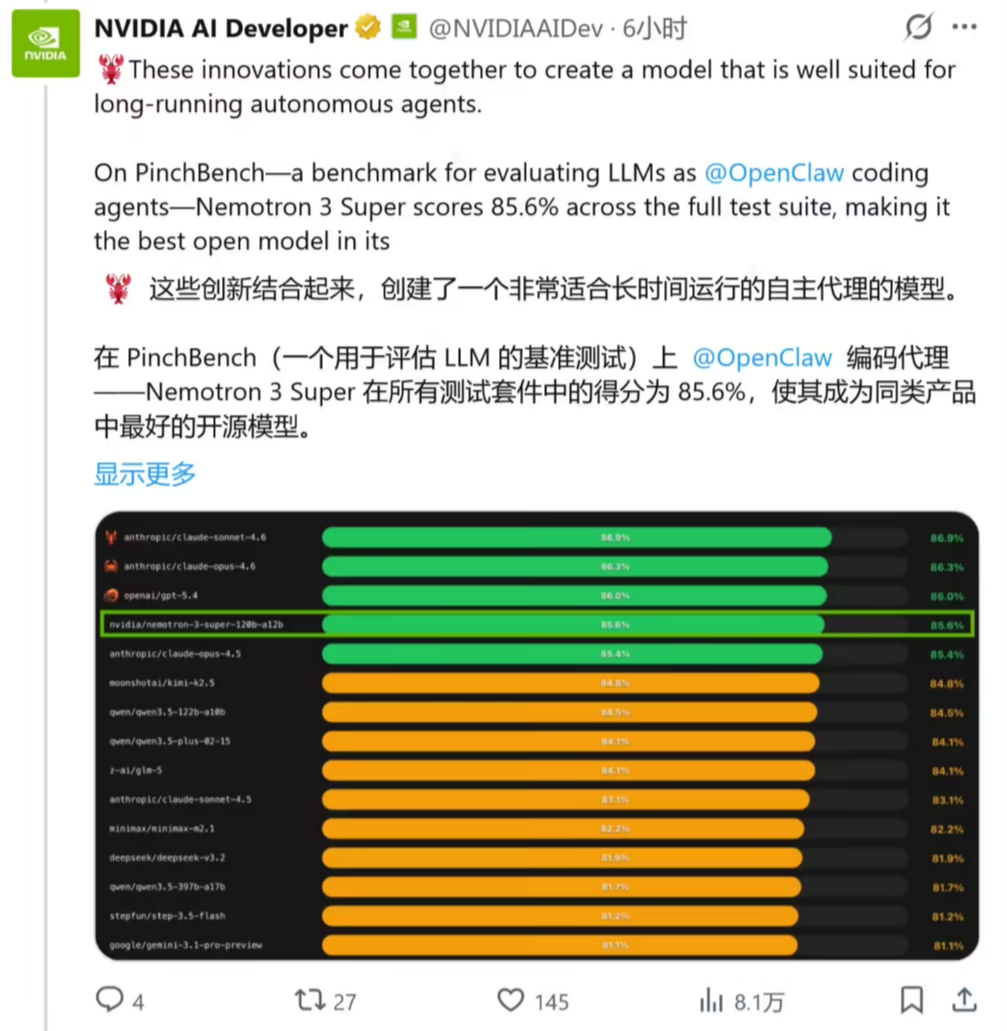

- 混合专家(MoE)架构:模型采用MoE架构,推理时仅激活约120亿参数,在保持强大能力的同时显著降低了计算开销。其吞吐量相比前代提升了5倍,准确率翻倍。

- 潜在MoE与多Token预测:模型引入了“潜在MoE”新技术,能以单个专家的计算成本激活四个专家,实现更细粒度的专业化。同时支持多Token预测,让推理速度提升3倍。

在英伟达最新的Blackwell平台上,该模型以NVFP4精度运行,相比Hopper架构上的FP8,内存需求更低且推理速度快4倍。目前,Perplexity、Palantir和西门子等行业巨头已将其应用于搜索、软件开发、电信和半导体设计等核心工作流中。

开发者目前可通过Hugging Face、谷歌云、甲骨文云等渠道获取该模型,AWS和Azure的接入也即将上线。同时,它已被打包为NVIDIA NIM微服务,支持无缝部署至本地数据中心和云端。