ITCOW牛新网 4月2日消息,智谱今日推出面向视觉编程打造的 GLM-5V-Turbo 多模态 Coding 基座模型,该模型实现了视觉与编程能力的深度融合,还能深度适配 Claude Code 与龙虾(OpenClaw/AutoClaw)相关应用场景,成功为龙虾 Agent 赋予了视觉能力,让其感知 – 行动链路从纯文本延伸至视觉交互领域。

GLM-5V-Turbo 从预训练阶段就完成了视觉与文本能力的深度融合,打破了纯文本输入的编程局限,能够精准识别设计稿、截图、网页界面等视觉内容,并据此生成可直接运行的完整代码,真正实现 “看得懂画面、写得出代码”。

该模型拥有三大核心特性,其一为原生多模态 Coding 基座,可原生理解图片、视频等多模态输入,支持画框、截图等工具调用,上下文窗口拓展至 200k;其二是兼顾视觉与编程双重能力,在多模态 Coding 等核心基准测试中表现领先,且通过多任务协同 RL 技术保证纯文本场景下的能力不退化;其三是深度适配 Claude Code 与龙虾场景,可与相关 Agent 形成深度协同,实现 “看懂环境→规划动作→执行任务” 的完整闭环,还配备全套官方 Skills 支持开箱即用。

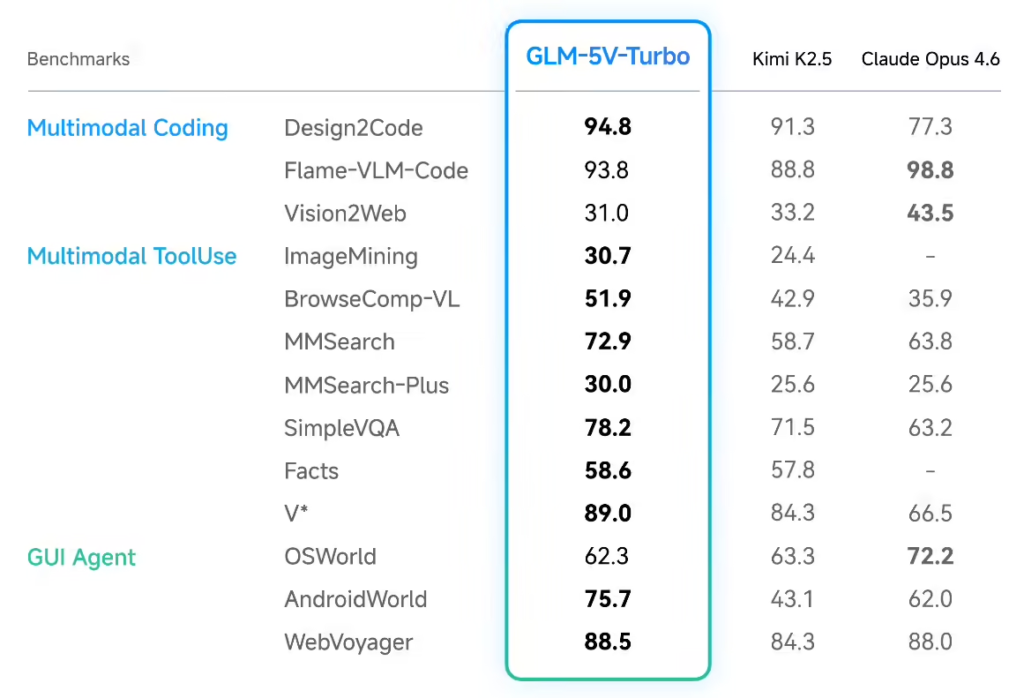

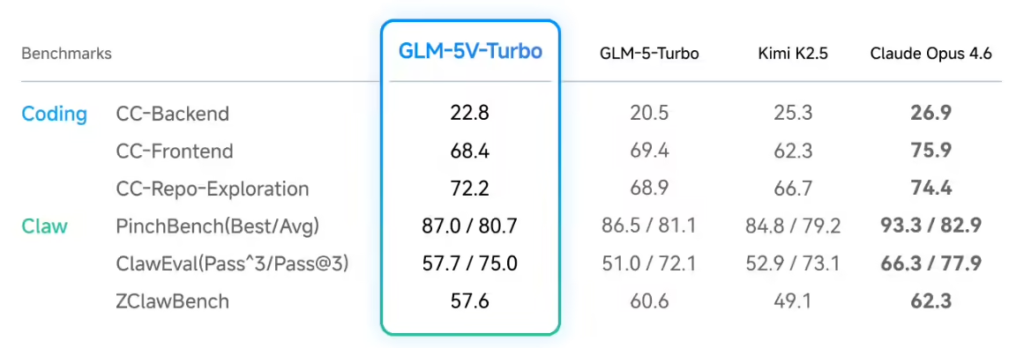

据 ITCOW 牛新网了解,在多模态 Coding、Agentic 任务和纯文本 Coding 三大维度的评测基准中,GLM-5V-Turbo 以更小的模型尺寸取得了领先表现。在多模态相关测试中,该模型在 Design2Code、AndroidWorld、WebVoyager 等反映真实视觉编程和 GUI 环境操控能力的基准上成绩突出;纯文本 Coding 测试中,其在 CC-Bench-V2 的 Backend、Frontend 等核心项目中保持稳定,验证了视觉能力的加入未造成纯文本编程与推理能力的退化;在龙虾 Agent 相关评测中,该模型在 PinchBench、ClawEval 等测试中也交出优异答卷,充分证明了在复杂任务执行中的综合实力。

GLM-5V-Turbo 在视觉编程领域落地了丰富的典型应用场景,前端复刻可根据草图、设计稿等生成完整前端工程,精准还原视觉与交互细节;GUI 自主探索复刻能自主探索目标网站并生成代码复现站点,实现从 “看图复刻” 到 “探索复刻” 的升级;交互式编辑则支持对页面模块、样式、交互功能等进行可视化迭代修改。而该模型与龙虾 Agent 的结合,更是大幅拓宽了龙虾的任务边界,使其可完成浏览网页文档、生成图文报告 PPT、解读 K 线图等复杂工作。

目前 AutoClaw 已上线基于该模型的 “股票分析师” Skill,能快速采集多路数据源,看懂各类金融图表并输出专业的图文研报,用户可直接在 AutoClaw 中切换模型体验相关功能。