ITCOW牛新网 4月25日消息,英伟达于今日发布博文,宣布其最新的 NVIDIA Blackwell 平台已成功适配 DeepSeek-V4-Pro 与 DeepSeek-V4-Flash 两款大模型。这一举措意味着开发者现在可以利用英伟达强大的硬件算力,通过 NVIDIA NIM 微服务或主流推理框架,快速部署这两款具备百万级上下文处理能力的前沿 AI 模型。

据ITCOW牛新网了解,此次适配的两款模型在参数规模与应用场景上各有侧重。DeepSeek-V4-Pro 拥有 1.6 万亿总参数量和 49B 激活参数,专为高级复杂推理任务设计;而 DeepSeek-V4-Flash 版本则包含 284B 总参数量和 13B 激活参数,主打高速响应与高效运行。两者均支持高达 100 万 Token 的上下文窗口及最长 38.4 万 Token 的输出,能够完美覆盖长文本编码、海量文档分析等核心应用场景,且均采用宽松的 MIT 开源协议。

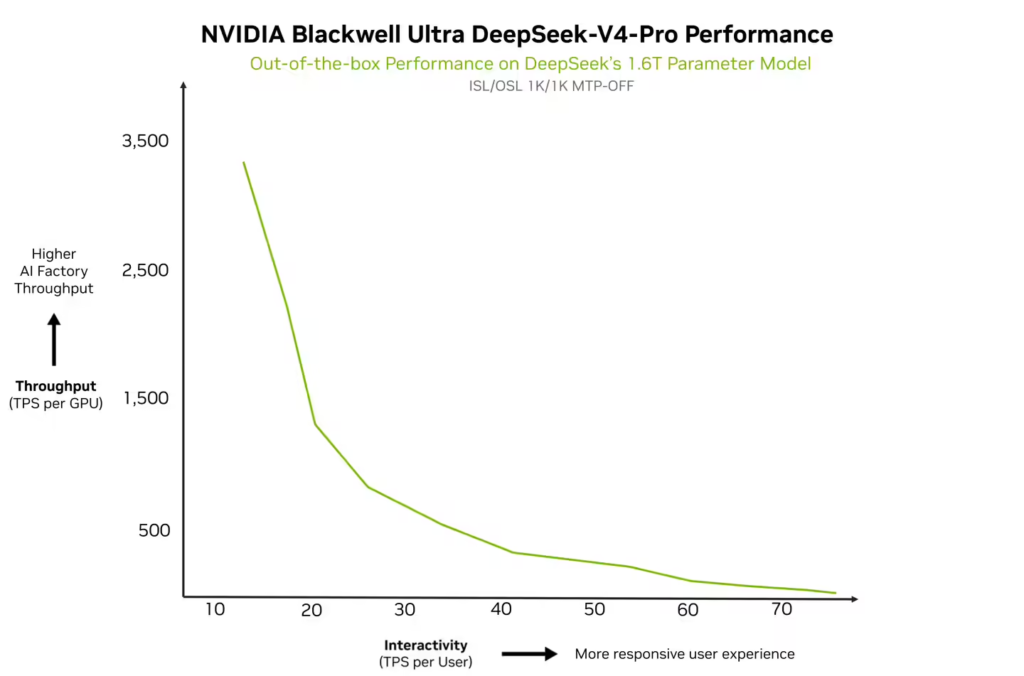

在性能实测方面,DeepSeek-V4-Pro 在 NVIDIA GB200 NVL72 系统上展现了惊人的推理速度,开箱即用性能已超过 150 tokens/秒/用户。开发者借助 vLLM 的 Day 0 配方,可在 Blackwell B300 上实现快速部署。随着未来对 Dynamo、NVFP4 及 CUDA 内核的深度优化,该平台的推理表现预计还将迎来显著提升。

为了让开发者拥有更灵活的部署选择,英伟达提供了完善的生态支持。除了通过 NVIDIA NIM 微服务进行一键下载部署外,开发者还可利用 SGLang 与 vLLM 框架进行定制化推理。其中,SGLang 提供了低延迟、均衡及最大吞吐量三种优化配方;vLLM 则具备强大的扩展能力,支持多节点扩展至 100 个以上 GPU,并集成了工具调用与推测解码等先进功能,极大降低了企业级应用的落地门槛。